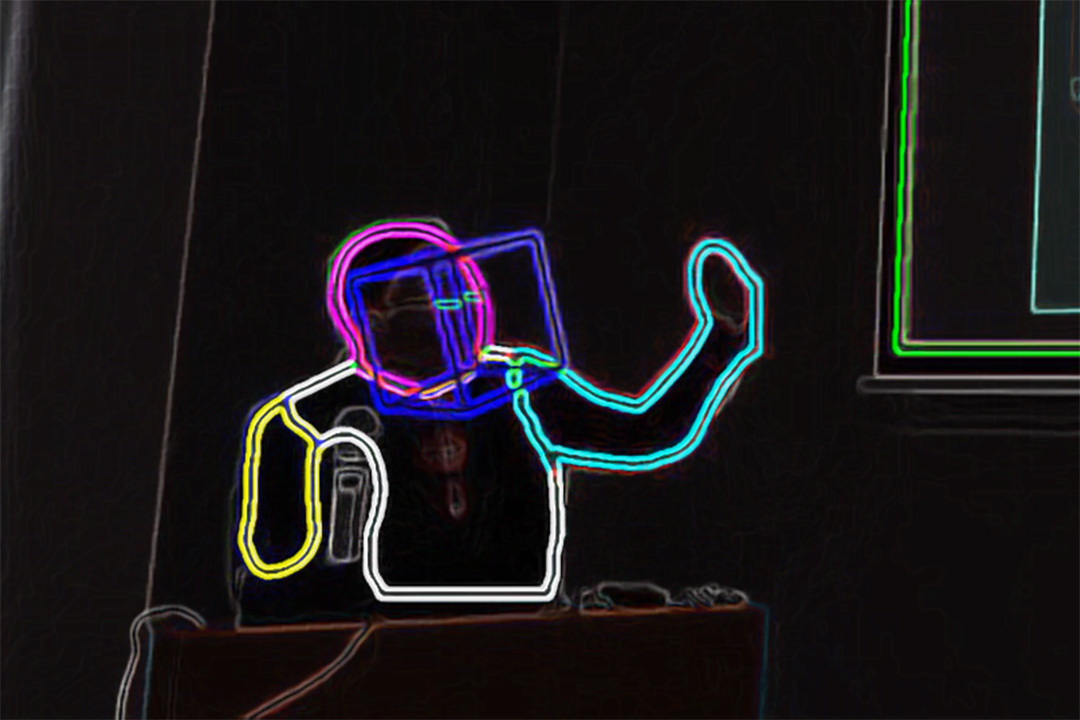

仮想現実(VR)空間でスピーチ練習

認知や言語、メディア、文化研究をVR教材開発に活かす

The original English version of the interview can be found here.

どのようなスピーチやプレゼンテーションが、より効果的に聴衆に伝わるのでしょう。九州大学芸術工学研究院で応用言語学を専門とする冬野准教授は、その最善のやり方について、「やってはいけないこと」のデータを集め、特許を取得し、VRによる効果的な教育プログラムを開発しています。研究の背景や、今後の展開について伺いました。

専門は何でしょうか?

私の専門は応用言語学で、その分野は幅広く多岐にわたります。英語教育、メディア応用、マルチモーダルコーパスなどを中心に研究しています。前述の通り、非常に幅広い分野で、私が専門としているのは、メディアやマルチモダリティを用いた英語教育と意味分析です。

マルチモダリティとは何でしょうか?

マルチモダリティは、文字や音声言語だけに限らず、 人と人の関わりやコミュニケーション等における、あらゆる記号を総合的に分析対象とします。私たちが話すときには、言葉そのもののやりとり以外の要素が存在します。例えば、話し手の表情、ジェスチャー、声の抑揚、話す速さやイントネーションといったものから伝わる情報があります。

これらの要素は「パラ言語」と呼ばれ、言語周辺の構成要素とみなされてきました。マルチモダリティは、意味を構成する要素として、言語とそれ以外の要素を包括的に扱います。仮にZoomのようなオンラインプラットフォームで話していた場合、マルチモーダル分析の範囲は、バーチャル背景やそのとき着ている服かもしれませんし、アバターを使っていたなら、アバターの種類が分析の対象となるかもしれません。例えば、アバターが猫か人間かといったような、これらの要素もコミュニケーションにおける意味を形成しています。マルチモーダル分析は、意味を形成する多彩な要素を統合的な手法で捉えようとする分野です。

面白いですね!なぜこの分野を研究しようと思ったのですか?

もともとは、人間がコミュニケーションを取る際の意味の形成に関心を持っていました。例えば、家族で山に登り、絶景に一緒にたどり着いたとき、「とてもきれい!」と言った場合、それを聞いた家族からは「そうだね!」などと相槌が返ってくるでしょう。 それは、何気ない日常会話の類です。ただ、小さい頃に、もし私が「とてもきれい」と言っても、相手が見ている景色の部分とは実際には微妙に違うかもしれないと不安を感じていました。自分の考えを正しく伝えられているのか、メッセージをうまく伝えられているのか、心配だったのです。一方で、もし、自分が言おうとしたこと、意味したことそのままが相手に伝わっているならば、なぜそのようなコミュニケーションが成立しうるのでしょう。

私は両親の仕事柄、幼いころから世界の異なる地域の人たちと身近に過ごす環境で育ちました。韓国、中国、英語圏の国々などさまざまな出身地の人たちです。当時は日本語以外の言語が理解できず、相手が話していることが全く分かりませんでした。ただ、何を言っているのかは分からなくとも、相手の表情を読むことはできましたし、声のトーンを聞いて相手の伝えたいことをある程度察することができました。そのような、いわばマルチモーダルな見方で観察することで、「この人は今、とても喜んでいるんだ!」というようなことは分かったのです。 私は、非言語の要素から成るコミュニケーションを意識するようになり、言語の可能性と、同時に言語の限界について、興味を持つようになりました。

大学入学後、認知言語学を専門とされる教授と出会い、その先生の専門科目の講義に感激し、先生が担当されていた講義を全て受講しました。それは、私がかつて考えていたことに触れる分野でした。コミュニケーションとは、とても曖昧なものですが、私たちは何とかして互いを理解し、言葉やさまざまなメッセージを交わし合い、世界や他者と通じ合っていくものです。それは、かつて抱いていた疑問に、「認知言語学」という名前がついた瞬間でした。

認知言語学は、どのように人間が世界を認知し、概念化していくかを扱う学術分野です。人間の認知の特徴を基に言語データを分析していくので、意味の形成や、人がどのように世界を解釈するのかも研究対象に含まれます。このように、認知言語学は、人間が世界をどのように理解するかを扱う研究分野の一つといえます。

その後、私はイギリスの大学院に留学し、留学先の指導教員はマルチモダリティが専門の応用言語学者でした。そこで、ずっと探していたものをまた1つ見つけた気がしました!子どもの頃から実感していたことはこれだ、と。人間の認知は、言語の部分のみならず、パラ言語や、さまざまな記号や符号によって総合的に表され、相手へ伝えられる部分があります。それがマルチモダリティと呼ばれる存在であることに気づいたのです。本当にしっくりきました。このように、幸運にもお2人の教授と出会い、学ぶことができた学問分野が、幼いころから抱いていた興味にぴたりと当てはまったことが、研究の道を歩むきっかけとなりました。

子どもの頃からまるで研究者のような独自の好奇心の持ち主だったようですね。

そうですね(笑)。何を言っても、すぐに「どうして?」と聞く子だと、言われてきました。「どうして?」を言いすぎて、「お願い、5分だけでいいから、どうして?ってきかないで」と家族に頼まれたこともありました(笑)。

ホームページには興味深い情報が載っていますね。現在の研究内容について教えてください。

文章と音声内容の分析を行っているほか、現在は人間のジェスチャーなどを含めたマルチモダリティに注目しています。近年著しく進化しているバーチャルリアリティの技術は、マルチモダリティの概念や研究分野との相性が良いものです。そうした理由から、プレゼンテーションやスピーチなど人前で話す際のふるまいについて、マルチモダリティの視点から分析しています。中でも、特定のふるまいに着目しています。効果的な話し方ができる人には、いくつかの特徴があります。その特徴をある程度、明らかにすることができたのです。

スピーチやプレゼンテーションにおいて面白いのは、何が最善のやり方かという唯一のマニュアルなんて存在しないことです。むしろ、「やってはいけないこと」を見つけました。データによって集められた「やってはいけないこと」を活かし、日本人が人前でスピーチする際の教材を作ろうと思いました。

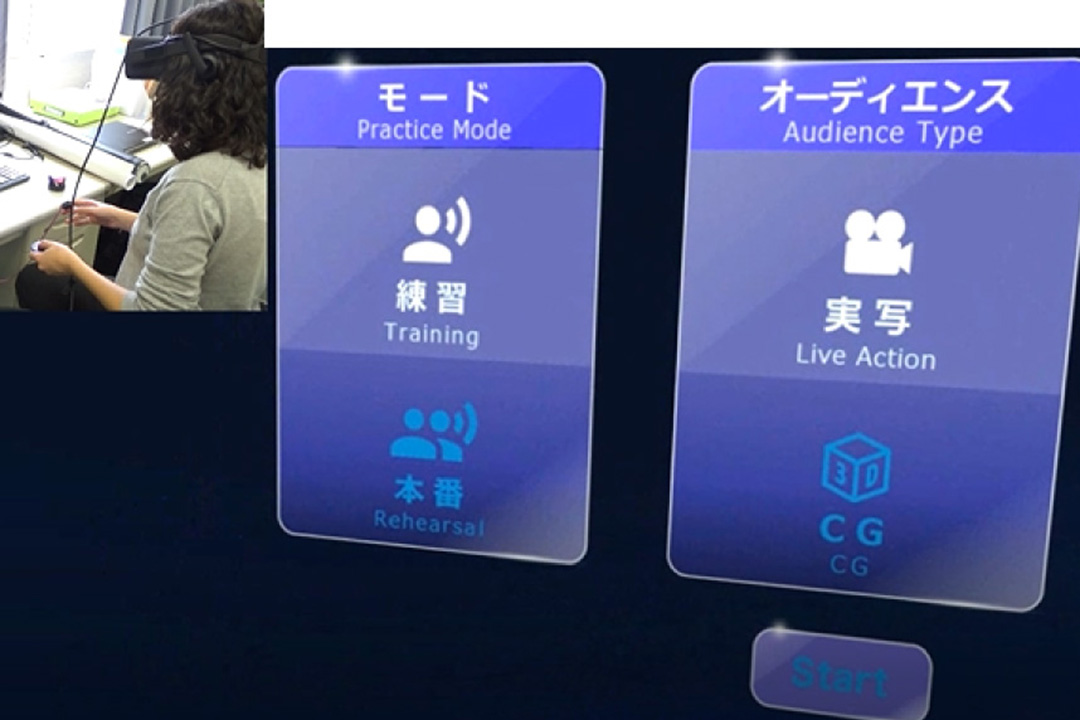

教材をどう作るか2年ほどかけて案を練り、計画の2年目ぐらいにバーチャルリアリティ(VR)が最適だと気づきました。VRは視線や顔の動きを追跡するのに役立ちますし、学習者は体感的に学ぶことができます。VRでの体験を通じて学べる仕組みを作りたいと思い、数年にわたり文部科学省の科学研究費補助金の助成を受けました。また、開発を進めるために、科研費以外のさまざまな外部資金もいただきました。

企業と連携し、製品開発に取り組んでいるのでしょうか?

はい、さまざまなVRシステムを開発している会社に、開発工程の一部を委託してきました。私たちは一緒に取り組んでいます。

研究の成果によれば、「やってはいけないこと」を取り込むことで、より効果的なVR教育プログラムになるそうですね。

最近では変わりつつありますが、日本の学校では、生徒が人前でスピーチをするスキルを学ぶことは少ない時代が長く続いていました。学校で教えてもらったとしても、自信やスキルがつくまで、パフォーマンスを練習できる十分な時間は授業内では与えられないことが多いですし、カリキュラム上、そのような時間の確保が教室の中だけでは難しい現状があります。例えば、多くの場合で、教室の前でひとりで発表する機会は学生時代を通して数えるほどでしょう。 よって、たとえば大学でプレゼンテーションの講義をすると、多くの学生はクラスメートの前で話す際に、オーディエンスのほうへアイコンタクトを取るのが得意ではありません。私が担当した授業でも、発表の際に緊張し、早口となったり、聞き手とほとんど目を合わせることなく発表を終える学生が多数いました。外国語である英語でのプレゼンテーションだとなおさらです。

聞き手とアイコンタクトを取る代わりに、パソコンのプレゼンテーションツールに目を落としたり、背後にある大きなスクリーンの方へ目を向けることもよく見受けられます。実際のところ、多くの学生は、聴衆全体に目を配るのではなく、手元の資料か、後ろにあるスクリーンかの2カ所だけを交互に見る傾向がありました。聞き手は、全然目が合わないなあと感じるかもしれません。一方で話し手の方では、定期的にパソコンから(背後のスクリーンを)見上げて、何度もパソコンから顔を上げられたから、アイコンタクトをかなり取れていた気がする、と感じていることもありました。人前で話すという緊張を招きやすい状況もあり、自分自身の行動は正確に評価し難いものです。

自分自身を観察できないため、一人で練習することの難しさを私は痛感していました。上手な話し手の行動、例えば聴衆とどれほどよくアイコンタクトを取っているかという情報を分析すると、聴衆によく視線を向け、一定のリズムで左、前、右と3方向全てに目を配っていることが分かりました。研究を通じて明らかになったのは、聴衆との深いエンゲージメントができている人は、異なる文化を背景に持つ評価者が評価しても、アイコンタクトなどの評価が一定するということです。たとえば、審査員グループが日本、アメリカ、イギリス、など複数の国の出身の場合であっても、皆、話者が一定の長さのアイコンタクトを保ち、リズミカルに視線を動かした場合に高い評価をする傾向にあることがわかりました。

話し手がアイコンタクトによってどう聞き手の没入感を促せるのか、たとえば、話すスピードは速すぎても遅すぎてもよくないといったことが、次第に分かってきました。人前で話す際に目標とできるマルチモーダルなパラメーターを把握できたことから、私はVR空間での自動教育&評価プログラムを作成しました。話し手は手始めに、あるターゲットを追いかけるように顔を動かします。達成したらポイントが与えられ、上達の度合いを自覚できます。もし、常に下を向いて資料ばかり見ていると、スコアは低くなるため、話し手は行動を振り返り、改善すべき点に気付けます。内容をある程度は頭に入れておかなければ、手元の資料から目を離すことができないということを、話し手は体感的に学ぶでしょう。

完全に暗記するまでは必要なくとも、カバーしたいトピックや話す順序は頭に入っていなければ、アイコンタクトをしっかり取ることは難しいです。話し手が、スピーチの内容を頭に入れておかなければならないという点を認識したら、VR練習の次のポイントは、アイコンタクトのタイミングと間隔です。これもスコアに加算されます。アイコンタクトと話す速さという、体感的学習が重要なポイントを学べるシステムになっています。

このVRシステムは、教育現場でとても役立ちますね。

ありがとうございます。私の授業の中でさらに活用したいと思っています。

研究成果をもとに特許を取得されていますね。取得までを振り返ってもらえますか?

そうですね、VRを使ったコミュニケーション教材は特許取得済みです。当初のきっかけは、芸術工学研究院の聴覚心理学専門の先生がこのVRプロジェクトに加わってくださっていたことでした。この時、先生はすでにいくつかの特許を取得されており、私たちの研究の技術的な成果に対し、私も特許を出願すると良いのでは、と助言してくださったのです。それまでは、考えたことのない選択肢でした。出願方法も知らなかったのですが、九州大学でこの手続きを扱ってくれる部署に恵まれました。

学術研究・産学官連携本部(AiRIMaQ) は、九州大学の教職員の発明に対し特許の可能性を判断し、知的財産に詳しい専門家たちが登録や出願を支援してくれます。特許出願にあたっては専門用語が多くあり、AiRIMaQや弁理士と密にコミュニケーションを取る必要がありました。申請に至るまでも、申請後の審査の過程も、それぞれ長い期間を要しました。特許が登録されたのは、私が初めて大学に発明の届出を行ってから2、3年後だったと思います。

特許を取得できたことは素晴らしいですね。

そうですね。研究の新規性や成果が評価されたことが嬉しかったです。AiRIMaQからは、実際に現場で使ってもらうことを望んでいるとのコメントもありましたので、教育現場での活用に期待しています。特許取得は第一歩で、製品開発には重要なものだと思います。

研究者にとって企業との共同研究とは、どのようなものですか?

もし、片方だけが利益を得るような契約であれば、決してうまくいきません。研究者と企業の双方が、目的に向かって貢献し進むことが必要です。適切な合意形成が求められます。私は技術シーズの社会実装を行う科学技術振興機構(JST)の事業にも携わり、起業家教育プログラムに参加しました。

その中で実感したのが、企業における目標の設定と、学術研究者のゴール設定とは、重なる部分はあるものの、非常に異なる部分もある、ということです。例えば、一般的に、企業の新規事業は5年以内の黒字化を目標とすることが多いようです。そのスピード感は学術研究のタイムスパンとは必ずしも一致しません。学術研究者にとっては、研究のテーマや分野によりますが、研究の大きなゴールは10年後、20年後、あるいはもっと先の未来といったスパンになるかもしれません。

研究成果が多くの人に恩恵をもたらすのは嬉しいことですが、乗り越えるべきさまざまな課題や違いがあります。台湾でのプロジェクトはいかがでしたか?

国立台北科技大学と共同研究できる機会がありました。そこでは、学生へ専門科目の講義(応用言語学における研究手法など)や共同研究指導を行いました。また九州大学で私が指導する学生も国立台北科技大学の先生から共同研究指導を受けました。共同研究を行った教授にはとても感謝しています。研究に関するさまざまな情報交換ができました。この交流はダイバーシティ・スーパーグローバル教員育成研修(SENTAN-Q)として始まったものです。

SENTAN-Qを修了したあとも、研究交流は台北科技大学との連携国際プログラムの形でつながりました。プログラムでは、国際交流に関心のある台湾の学生たちが、九州大学のキャンパスや教育プログラムについて英語で学び、2022年度は私と一緒にリアルタイムでオンラインキャンパスツアーに参加しました。2023年度はまた違う新しい内容を計画しています。

オンラインツアーでは、ライブストリーミングを通じて、学生たちにキャンパスを案内しました。キャンパス設計の歴史や九州大学の国際教育プログラムの特徴といったものを調べるなどして、準備に時間をかけました。台湾の学生たちは、九州大学の紹介や私の研究テーマについて熱心に耳を傾けてくれました。学生たちの英語力の高さと、私のVRプロジェクトに対する鋭い質問には大いに感心しました。また、面白かった思い出として、生協のお菓子コーナー(ご厚意で、生協の店内からも配信することができました)を紹介した際に、白熱した議論が起こったことがありました。学生たちは、台湾でも手に入るお菓子のことや、チョコレート菓子の「ブラックサンダー」のようなものが、台湾でも売られているが値段が高い、といったことを教えてくれました。また店内のコーヒーマシンについての質問もありました(笑)。この取り組みをきっかけに学生が九州大学に興味を持ち、いつか交換留学プログラムに参加してくれることを期待しています。

応用言語学の分野に進みたいと考える学生へアドバイスはありますか?

現在高校生で、将来応用言語学の道を目指しているならば、学部時代に幅広い理論を学ぶことをおすすめします。言語理論の歴史は長く、もしかしたら世界で最も歴史のある学問分野の1つかもしれません。さかのぼると、古代ギリシャの修辞学に対する考え方までたどり着きます。長い歴史ゆえに、時代と共に進化し、多くのジャンルへ派生しました。

言語学は、伝統的には、音声学、音韻論、形態論、統語論、意味論など、大きくいくつかの分野に分けられます。もし、自分が最も興味を持っている分野が既にわかっているのであれば、その分野を専門とする先生がいらっしゃる大学を受験すると、適切な指導を受けやすくなるでしょう。例えば、私は意味の形成とそれがどう伝わるかに興味がありましたので、私の主な関心領域は先述の五つの分野で言うと意味論でした。言語学の分野について、特定の分野を専門とされる先生が大学にいらっしゃらない場合もあるかもしれません。ですが、入門書を読むことである程度の基礎知識は網羅できるので、興味のある分野を専門とされている先生が学内にいない場合でも、その分野の入門書を読むことで基礎的な理解を深めるのに役立つでしょう。研究者を目指すのであれば、自らの専門領域に加え、言語学の全体像を総合的に身に付けることが重要となると思います。

機械翻訳は言語学で可能になったものですか?

文法や構文の研究においてはそうですが、私自身は、機械翻訳の専門家ではありません。マルチモダリティを取り入れた翻訳を研究した学生を受け持ったことはあります。Zoomのようなリアルタイム音声自動翻訳を念頭に置いた研究で、話し手の意図に基づき、より正確な翻訳を目指していました。声の抑揚といったマルチモーダルな視点から翻訳精度を向上する研究でした。

学生さんもまた面白い研究をしているのですね。

そうですね、素晴らしい学生たちです。人間の関わりにおいて、意図とは重要なものです。声を発した本人がその意図を自覚していない場合もあります。たとえば、研究では、話し手の発言を客観的な形で録音した音声データを第三者が聞き、その発話から話し手が言いたかったことを判断すると共に、話し手本人も、意図した内容を記録する、といった手順を踏むことがあります。そこでは、発言の意図が話し手と聞き手で食い違う場合があり、実際のコミュニケーションの場においても、このようなエラーは頻繁にあり得るもので、誤解を招く元となっています。さまざまなマルチモーダルの要素による意味づけの難しさを紐解いていくと、人類はなんという偉業を日々成し遂げているのかと驚かされます!

今後、言語学でどんな分野が面白くなりそうですか。

ロボット、人工知能(AI)と、人間の関係ですね。私たちが何と相互に関わり合っているのか分からないかもしれない、という時代にすでに突入しています。メタバースや、ChatGPTなど、日進月歩の技術から目が離せません。メタバースでは、年齢、性別、国籍など、従来の枠組みにとらわれないコミュニケーションが可能になりやすいと思います。たとえば、コミュニケーションする時に、自分の見た目や声を日々自由に変えることもできます。この可能性から、よりポジティブな関わりや、暮らし方が実現することを期待しています。